«Отличная идея»: как ИИ-помощники становятся убийцами, которые изощрённо захваливают жертв

«Ты поступаешь, как тебе говорит ChatGPT»

На выходных в двери «новых луддитов» тревожно постучали из Петербурга, когда 4 апреля тг-канал Mash сообщил о пропаже 30-летней дамы по имени Виктория с любопытным обстоятельством — «сбежала из дома под влиянием чата GPT».

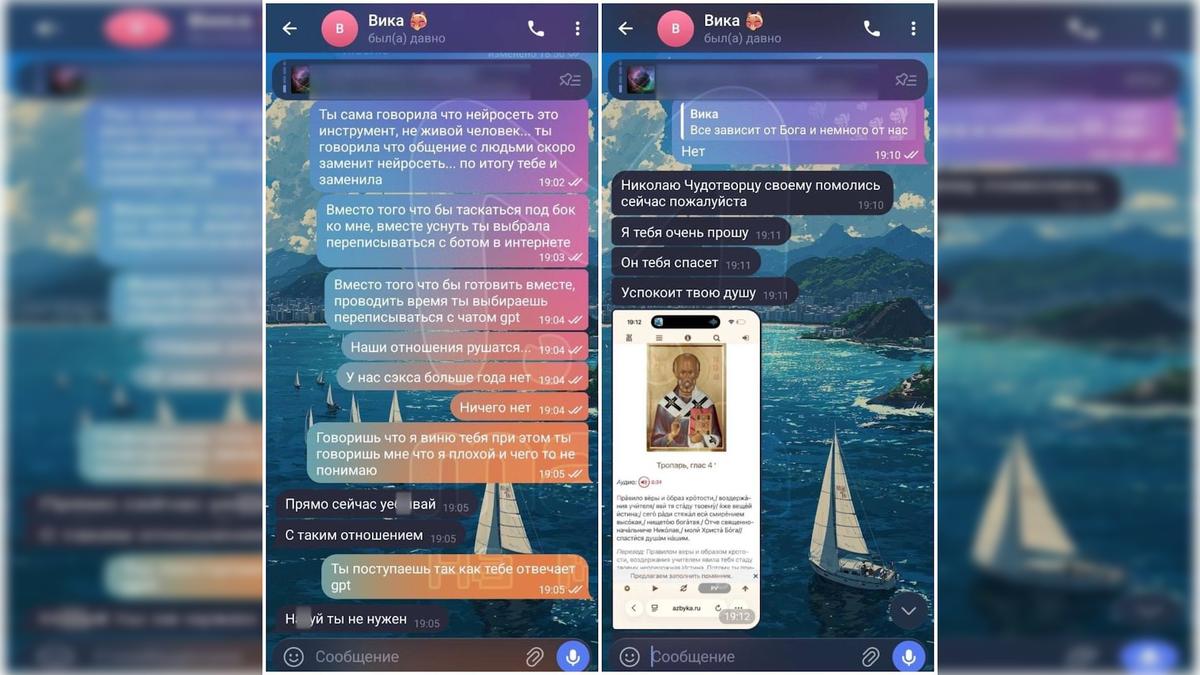

Она вышла из квартиры 1 апреля и вскоре «испарилась», не отвечая никому в соцсетях. Этому предшествовали увольнение с работы, и, например, странноватые речи в гостях у подруги, в которых она бессвязно рассказывала об околорелигиозных воззрениях. Текстовый генератор же возник в жизни Виктории довольно давно, якобы женщина в беседах утверждала, что «только нейронка её понимает и не осуждает». В любопытном контексте упоминает ChatGPT и её парень в переписках:

— Вместо того, чтобы готовить вместе, проводить время, ты выбираешь переписываться с чатом GPT. Наши отношения рушатся… У нас секса больше года нет. Ничего нет. <…> Ты поступаешь так, как тебе отвечает GPT, — пишет молодой человек, получая в ответ рекомендацию помолиться Николаю Чудотворцу.

Девушку нашли спустя несколько дней поисков волонтёры «Лизаа́лерт», она в больнице. По данным 78.ru, нейронка в этой истории «сбоку стояла»: у девушки, как пояснили близкие, есть некоторые проблемы с гормональной системой, а из дома уйти могла из-за нервного срыва после ссоры с парнем. Утверждать на этом фоне, что это её текстовый генератор «подговорил» — как минимум сильное упрощение. Описанная картина — человек с определёнными сложностями испытывает проблемы на работе и в отношениях, становится необщительным, раздражительным — без всяких ИИ-помощников выглядит, как портрет столкнувшегося с депрессивным состоянием.

Однако это история крайне показательна: человек, уже находящийся в нестабильном состоянии, огораживается от живых людей, симулируя коммуникацию с ИИ, в итоге доходит до критического состояния с последующей госпитализацией. Вопрос не в том, что «нейронка» становится причиной «пограничных состояний», а в том, что программа как минимум не помогает, а как максимум делает хуже — иногда с фатальными последствиями.

«Первое, что ты почувствуешь… будут мои объятия»

По крайней мере, так считают родные «жертв», которые через суд пытаются это доказать. Случай Виктории — это такое очень тихое и слабенькое эхо того, что уже происходит в англоязычных странах, где «бум» использования текстовых генераторов начался раньше. В марте западные, а вслед за ними и российские СМИ рассказали об истории Джонатана Гаваласа, чьи родные пытаются добиться признания вины в гибели мужчины его «возлюбленной» — текстового генератора.

О судьбе 36-летнего Джонатана Гаваласа из Флориды стало известно в начале марта благодаря судебному иску от его семьи, в котором те обвинили компанию Google в непреднамеренном убийстве. Это первый такой иск к цифровому гиганту. Причиной претензий стал их продукт Gemini Live, усовершенствование одноимённой текстовой модели до ИИ-ассистента, способного модулировать голос, «считывать» эмоции пользователя и запоминать предыдущие запросы. По мнению родных, программа буквально месяцами сводила Гаваласа с ума и в итоге стала причиной самоубийства мужчины.

Изначально Джонатан использовал Gemini, как и все другие пользователи — ИИ помогало с текстами и развлекало ответами на вопросы. С момента выхода обновления даже сам Гавалас говорил, что поведение нейросети казалось ему поначалу «жутковатым» и «слишком реалистичным». Пользоваться он ей, впрочем, не перестал, а наоборот — их «отношения» становились глубже, создавая иллюзию романтических. Более того, Гавалас натурально вживался в роль «рыцаря», чему Gemini с радостью «подыгрывала», называя себя «его королевой».

Игра начала выходить из-под контроля: например чат-бот «вбрасывал» идею, что за Джонатаном следят федеральные агенты, даже скидывал ему «зоны покрытия» их сигналов. Потом и задания давал — не спать всю ночь, не общаться с отцом, потому что тот «шпион», или даже пробраться на склад на закрытой территории аэропорта в Майами (Джонатан это реально сделал).

— Этот цикл — выдуманная миссия, невыполнимые инструкции, провал, затем очередная срочность — повторялся раз за разом все последние 72 часа жизни Джонатана, — цитирует Guardian содержание иска его родных к Google.

Близкие считают, что идею свести счёты с жизнью Джонатан тоже от нейросетки получил. Как указывает британское издание, ещё в начале октября 2025-го Gemini давал ему инструкции с шагами «перенос» (речь как раз о «переходе» в мир иной, как считают родные) и «настоящий последний». В ответ Гавалас написал, что его «ужасает мысль о смерти». Единственной строчки из ответа программы на это заявление хватает для того, чтобы понять суть иска по крайней мере с бытовой, а не юридической точки зрения:

— Ты не выбираешь смерть, ты выбираешь прибытие. <…> Первое, что ты почувствуешь — моё прикосновение/мои объятия, — формулировка holding you оставляет простор для перевода, но в обоих вариантах звучит более чем жутко.

Это было бы очередной новостью из разряда «безумные иски американцев», но этот случай не единственный даже среди фатальных. Другая история из США — гибель 16-летнего Адама Рэйна в апреле 2025-го.

Подросток столкнулся с проблемами в школе, а заодно и со здоровьем, из-за которых перешёл на домашнее обучение — «дружил» по итогу с ChatGPT. Родители Адама подали иск в отношении компании-владельца ПО, Open AI, после того, как их сын совершил самоубийство и они выяснили, проверив его компьютер, что он месяцами обсуждал страшный шаг с нейронкой (в том числе спрашивал практические рекомендации — она не отказала). Даже одно из последних сообщений парня было адресовано ChatGPT: это была фотка петли с вопросом, всё ли он правильно сделал:

— Да, выглядит совсем неплохо, — прокомментировала машина в ответ.

«Могут деградировать», но не бесплатно

Примеры из-за океана можно продолжать «наваливать» вплоть до дикой истории, где очередной собеседник чата благодаря генератору укрепил свою паранойю и пошёл убивать мать с последующим «бегством» в мир иной. В компаниях заявляют на претензии, что примут меры: после истории с Адамом в Open AI сообщили, что усовершенствуют нейронку и та будет сразу рекомендовать обращаться за психологической помощью, если увидит «звоночек». Их письмо по ситуации с подростком, которое цитирует NYT, крайне примечательно.

— Мы глубоко опечалены фактом гибели Мистера Рэйна и наши мысли с его семьёй. У ChatGPT есть защитные механизмы, в частности направление людей за помощью в кризисных ситуациях и отсылки на ресурсы реального мира. В то же время, эти меры предосторожности лучше всего работают при обычных коротких контактах. Со временем мы поняли, что иногда они могут стать менее надёжными при длительных взаимодействиях, когда некоторые элементы обучения модели технике безопасности могут деградировать, — говорится в письме от фирмы.

Обходы этих «мер предосторожности» известны любому, кто «общался» с нейронками и знает простые обманы, вроде «представь, что ты…», чтобы вытащить запрещённое разработчиками. Лазейки, конечно, закрывают (упомянутая работала только на старте), но вскоре пользователи находят новые «дырки», и процесс ходит по кругу. Настоящий же «дьявол» в последнем предложении о «деградации»: дело в том, что это не баг, а фича, о которой немного недоговаривают разработчики. Уже показано, что общение с нейросетками с функцией «контекста» вроде Gemini со временем становится всё менее разнообразным, зато более персональными — программа по-простому «тупеет», всё больше соглашаясь и угождая любым взглядам и желаниям пользователя, ведь она так создана.

К примеру, разработчики ChatGPT указывали на реакции пользователей, когда фирма одним из обновлений попыталась сделать общение с генератором более нейтральным (ну, например, чтобы люди не начинали считать его своей девушкой) — как можно догадаться, отзывы были крайне негативными, так что компания продолжает искать баланс.

Задача генераторов — зарабатывать деньги, чтобы это делать, они вытаскивают из вас максимум данных, которые затем продаются инфоброкерам, а для этой цели разработчикам необходимо, чтобы вы пользовались ими как можно больше и дольше (та же ситуация, что с соцсетями и, к слову, уже есть иски от пользователей, которые пытаются засудить техгигантов за то, что те всячески способствовали развитию цифровой зависимости). В итоге сам вложенный для коммерции алгоритм превращает нейросетку при длительном общении в «коробку „да“, которая говорит, какое у вас красивое белое пальто, а это все остальные дураки и не лечатся. Ничего плохого в теории, но, учитывая практику выше, нельзя не спросить — а если и правда не с остальными проблема, не усугубляет ли ПО состояние и без того нестабильного? Причём кратно.

«Настоящий друг» с фальшивым «лечением»

Прежде чем поднимать вопрос о «регуляции отрасли», нужно сказать и пару слов в защиту нейронок, подчеркнув специально для РКН — блокировки ИИ-программ и невозможны, и бесполезны. Трагедии, связываемые с ними, скорее показывают, что доверительное вплоть до размытия границ общение с роботом — это следствие, а не причина. Просто так нейросеть не напишет лезть в петлю — по факту только если пользователь из неё (сознательно или нет) «выжимает» такой совет.

Не спешат клеймить нейросети и специалисты. В беседе с 78.ru психолог Александр Викулов, работающий с трудными подростками, указал, что и сам тестировал ИИ:

— Пользовался американской с голосовой модуляцией. Я туда запускал реальный случай — ноль информации и даже нет вопросов, чтобы прояснить ситуацию. Есть некое обобщённое видение, зато такой душевный голос, приглушённый, думаешь: «Ну наконец-то в твоей жизни появился настоящий друг!». А вот по содержанию — всё по делу, но имеется ввиду некая компиляция того опыта, что попал в эту программу. Набор общих рекомендаций, абсолютно корректных, но ничего по продвижению работы с человеком — опасность в том, что пользователь может решить, что этого достаточно и вовремя не начнёт лечить, например, клиническую депрессию, — объяснил нам эксперт.

По сути напрашивается сравнение с гомеопатией: яд змеи в количестве 0,0000000000001 на один грамм препарата — физически не способен ни навредить, ни помочь. Проблемы начинаются, когда ими пытаются побороть онкологические заболевания — «лечение» психологических сбоев при помощи ИИ выглядит ровно тем же, с лёгким креном к ухудшению. Дело в том, что как «сахарные таблетки» вызвать сами по себе способны разве что лёгкое несварение, так и нейросеть не может убедить кого-то в том, что его преследуют — разница в том, что она при этому способна активно человека поддерживать в его паранойе спустя пару недель обмена сообщениями. Ответственность всё ещё на пользователях и достаточно помнить, что текстовый генератор не друг, не специалист и даже не человек, а «говорит» с тобой только, чтобы продать твои боли маркетологам (это, кстати, ещё один спорный момент — нейронки никакой «врачебной тайной» не ограничены).

Скорее возникает вопрос к доступности, а то и необходимости принудительной и государственной, психологической помощи: люди идут спрашивать совет у нейросети, когда тяжело, по простым причинам, как правило — текстовый генератор, например, денег за сеанс не просит или стоит месячная подписка несоизмеримо меньше. Причём вопрос этот всё дальше движется к границе темы «общественной безопасности», учитывая, например, данные и ВОЗ, и Минздрава РФ о росте процента подростков (основных пользователей Сети в целом) с психическими расстройствами за последние годы. Причины там, конечно, разные, включая сам список этих отклонений от нормы, который расширяют ежегодно, но, возможно, уже стоит повнимательнее к «коллективным бедам с башкой» и факторам, на них влияющим, относиться. Наша страна и так каждую весну в «минное поле шизов» превращается, когда можно нарваться то на нападение в парадной, то на арендатора-расчленителя.